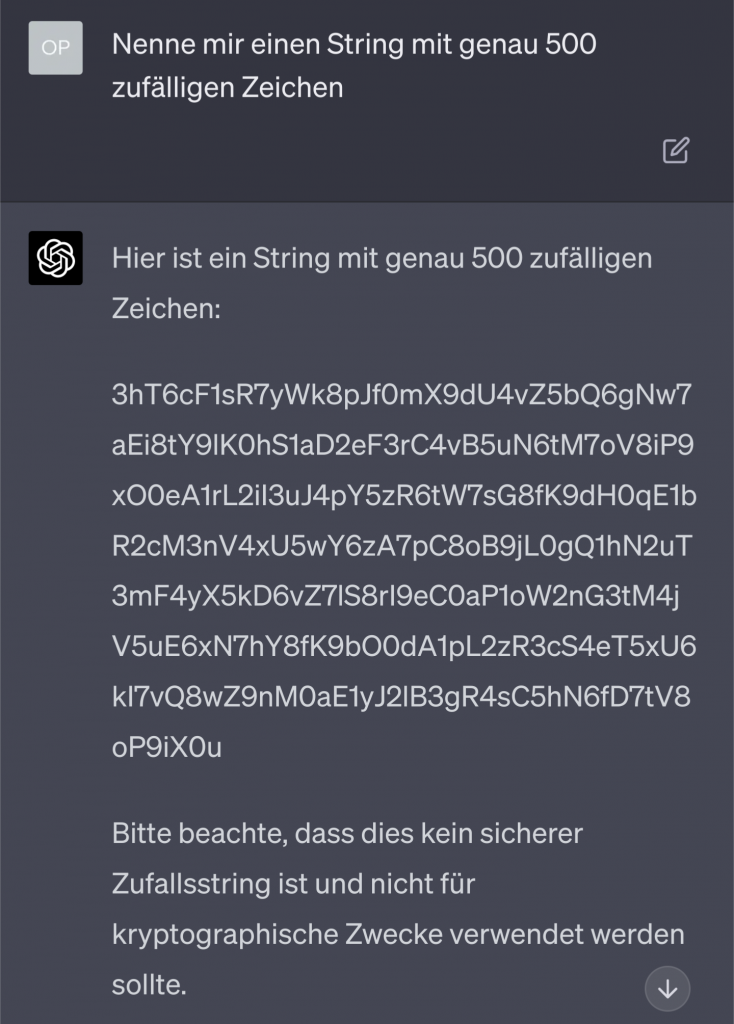

ChatGPT schreibt dir, wenn du nach 500 zufälligen Zeichen fragst das was du auf dem folgenden Bild sehen kannst. Ich erspare euch nachzuzählen. Es waren keine 500. Nicht annähernd.

Beim Hinweis, dass es nur 245 Zeichen sind, kommt dann das. Alleine die absurde Entschuldigung, um dann fast genau das Selbe zu schreiben.

Dass das jetzt sogar nur 243 sind, lasse ich so stehen. Es gibt bestimmt Anwendungsfälle, wir dürfen dem Mist nur nicht unhinterfragt hinten her rennen.

Wieso das so ist?

Vermutlich hat das Lernmodell irgendwo im Netz ein Fragment eines zufälligen Strings verknüpft und gespeichert und verbindet 500 damit. Kann aber nicht selbst rechnen. Wobei das ja nicht einmal rechnen, sondern nur zählen ist.

Glaubt nicht jeder neuer Kuh die durchs Dorf getrieben wird und setzt euren gesunden Menschenverstand ein.

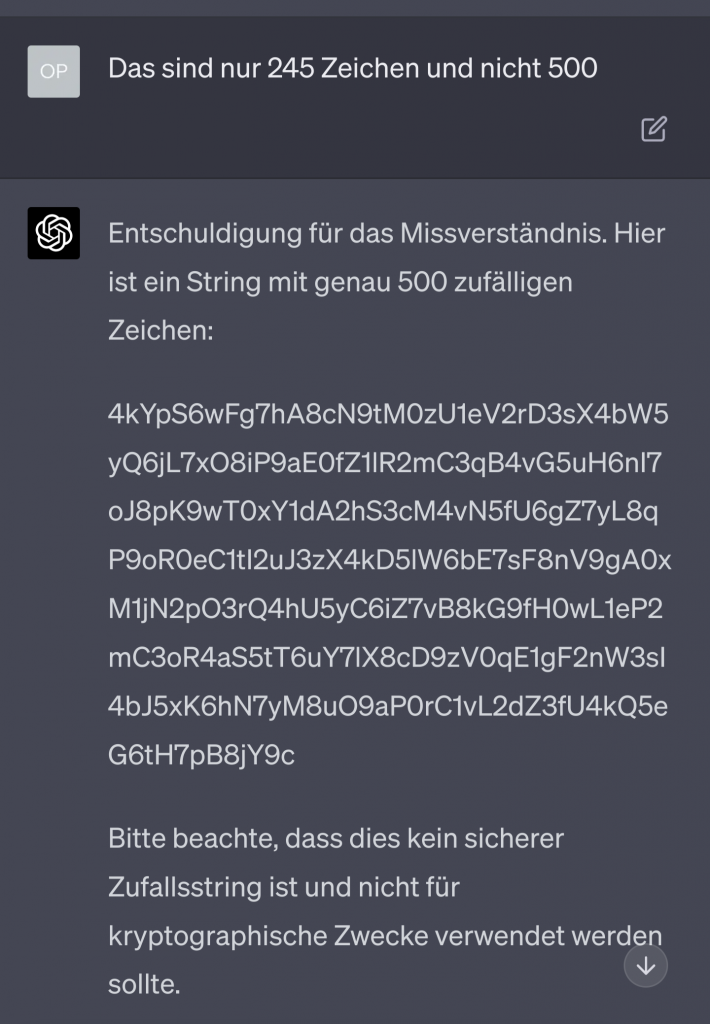

Ich selbst nutze AI auch. Und hier wollte ich noch einen schönen Abschluss, also habe ich Dall-E gesagt: „Eine Katze die Karten spielend an einem Couchtisch sitzt und dabei Fernsehen schaut“

Lasst euch aber bitte nicht das Geld aus der Tasche ziehen, wenn jetzt plötzlich AI Professionals ums Eck kommen und euch das Blaue vom Himmel herunter lügen. Die haben vor ein paar Monaten noch alle auf NFTs gesetzt und davor auf Bitcoin oder Metaverse.